Eine Mitschrift zu der Vorlesung

„Theoretische Informatik 2“

gehalten an der

Johann Wolfgang von Goethe Universität Frankfurt

von

Herr Prof. Dr. Wotschke

Fassung vom 19. Oktober 2000

Heruntergeladen von:

Autoren:

Frank Bergmann (bergmann@informatik.uni-frankfurt.de),

Jörn Gersdorf (gersdorf@informatik.uni-frankfurt.de),

Martin Klossek (klossek@informatik.uni-frankfurt.de),

Fabian Wleklinski (wleklins@informatik.uni-frankfurt.de)

1 Inhaltsverzeichnis

2 Vorlesung vom 11. April 2000

2.1 Mengen, Mengenoperationen und Relationen

2.1.1 Funktion, Umkehrfunktionen und Abbildungen

2.1.2 Injektivität, Surjektivität und Bijektivität

2.2.1 Die algebraische Struktur

2.2.4 Das freie Erzeugendensystem, das freie Monoid

2.5 Klassifizierung von Sprachen

3 Vorlesung vom 13. April 2000

3.1 Abzählbarkeit von Mengen, Diagonalisierung

3.1.3 Abzählbarkeit rationaler Zahlen

3.1.4 Überabzählbarkeit reeller Zahlen

3.2 Transitive und reflexive Hülle

3.3 Endliche Automaten (FSM, DFA)

3.3.1 Veranschaulichung und Darstellung

3.3.4 Beispiel eines endlichen Automaten

4 Vorlesung vom 18. April 2000

4.1 Beweis eines DFA (deterministischer endlicher Automat)

4.2.5 Beweis der Sprachäquivalenz

4.3 Nichtdeterministische Endliche Automaten (NFA)

4.3.2 Erweiterung von d des NFA

4.3.3 Die vom NFA erkannte Sprache

5 Vorlesung vom 20. April 2000

5.1 Über die Äquivalenz von DFA und NFA

5.1.4 Beispiel 1 (Konstruktion eines DFA aus einem NFA)

5.1.5 Beispiel 2 (Konstruktion eines DFA aus einem NFA)

5.2 Satz über die Minimierung von Zuständen

6 Vorlesung vom 25. April 2000

6.1 Nachtrag zur vorherigen Vorlesung

6.2 Mathematischer Hintergrund

6.2.1 Erweiterung des Begriffes „Äquivalenzrelation“

6.3.3 Reguläre Ausdrücke vs. endliche Automaten

6.4.1 Definition des Nerode Automaten

6.4.2 Repräsentantenunabhängigkeit des Nerode Automaten:

6.4.3 Regularität des Nerode Automaten:

6.4.4 Minimalität des Nerode Automaten

6.4.5 Eindeutigkeit des Nerode Automaten

7 Vorlesung vom 27. April 2000

7.1.1 Homomorphismus und Isomorphismus

7.1.2 Minimalität und Eindeutigkeit des Nerode Automaten

7.2 Minimierung von endlichen Automaten

7.2.1 Rekursion der k Relationen

7.2.2 Verfeinerung von Äquivalenzrelationen

7.2.3 Anwendung auf k Relation zur Zustandsreduktion

8.1 Minimierung mittels Nerode Automaten

8.1.1 Satz über die Gleichwertigkeit von Relationen

8.1.2 Konstruktion eines minimalen Automaten

8.2 „Praktische“ Minimierung von deterministischen endlichen Automaten

9 Vorlesung vom 04. Mai 2000 Abschlußeigenschaften regulärer Mengen

9.2 Sammlung von Abschlußeigenschaften

9.2.1 Beweise Vereinigung, Konkatenation, Kleenesche Hülle

10.1 Beispiele zur Nutzung der Abschlusseigenschaften

10.2 Automaten mit e-Bewegungen

10.2.3 Formale Unterschiede zum gewöhnlichen NFA

10.2.4 Äquivalenz vom NFA mit und ohne e-Bewegungen

11.1 Äquivalenz von endlichen Automaten und regulären Ausdrücken

11.1.1 Von regulären Ausdrücken zu endlichen Automaten

11.1.2 Vereinigung zweier regulärer Ausdrücke als NFAs

11.1.3 Schnitt zweier regulärer Ausdrücke als NFAs

11.1.4 Kleensche Hülle eines regulären Ausdruckes als NFA

11.1.5 Beispiel: Konstruktion eines NFA mit e‑Übergängen für einen regulärem Ausdruck

11.1.6 Von endlichen Automaten zu regulären Ausdrücken

12.1 Wiederholung der letzten Vorlesung

12.2 Beispiel zur Umwandlung eines Automaten dem entsprechenden Regulären Ausdruck

12.3 Endliche 2-Wege Automaten

13.1.1 Beispiel zu Grammatiken

13.2 Die Äquivalenz von regulären Grammatiken und endlichen Automaten

13.5.2 Definition der Entscheidbarkeit

13.5.3 Beispiel: Entscheidbarkeit der leeren Sprache

13.5.4 Beispiel: Entscheidbarkeit der unendlichen Sprache

13.5.5 Beispiel: Entscheidbarkeit der endlichen Sprache

13.5.6 Beispiel: Entscheidbarkeit der Schnittmenge

13.5.7 Beispiel: Entscheidbarkeit der Teilmenge

13.5.8 Beispiel: Entscheidbarkeit der Äquivalenz

13.6 Kontext-freie Grammatiken

13.6.1 Beispiel zur Kontext-freien Grammatik

14.1 Ableitungen von Wörtern in kontextfreien Grammatiken

14.1.3 Beispiel für einen Ableitungsbaum

14.1.4 Die Beziehung zwischen Ableitungsbäumen und Grammatiken

14.2 Vereinfachung kontextfreier Grammatiken

15.1 Reduktion von Grammatiken

15.1.1 Definition Brauchbarkeit von Nichtterminalsymbolen

15.1.2 Das Problem der Ausführung der beiden Schritte

17.2 Formale Definition, Konfiguration, Akzeptierung

17.3 Äquivalenz von PDA und kontextfreier Grammatik

17.3.1 Äquivalenz PDA und kontextfreie Grammatiken

18.1 Für jede CFL existiert ein PDA

18.1.1 Fortsetzung des Beweises vom 06. Juni 2000

19 Vorlesung vom 15. Juni 2000

19.1 Greibach Normalform (GNF)

19.1.2 Umwandlung von linksrekursiven in rechtsrekursive Produktionen

19.1.3 Kontextfreie Grammatiken in Greibach Normalform (GNF)

20 Vorlesung vom 20. Juni 2000

20.1.1 Beispiele für Kontextfreiheit und Nichtkontextfreiheit

21 Vorlesung vom 27. Juni 2000

21.2 Turing-Maschinen und Entscheidbarkeit

21.2.1 Problem, Algorithmus, Entscheidbarkeit

21.2.2 Modelle für Algorithmen

21.2.5 Universelle Turingmaschine

21.2.6 Arbeitsweise der universellen Turing-Maschine

21.2.7 Halteproblem für Turing-Maschinen

2 Vorlesung vom 11. April 2000

2.1 Mengen, Mengenoperationen und Relationen

2.1.1 Funktion, Umkehrfunktionen und Abbildungen

Eine Funktion ist eine eindeutige Zuordnung der Elemente einer Menge A zu den Elementen einer Menge B. Jedem Element von A darf höchstens ein Element von B zugeordnet sein, verschiedenen Elementen von A kann aber dasselbe Element von B zugeordnet sein. Es braucht nicht jedem Element von A ein Element aus B zugeordnet zu sein.

Für beliebige Funktionen gilt:

![]()

Anmerkungen dazu:

Es ist zu beachten, dass f’() keinesfalls die Umkehrfunktion ist – zu dieser wird es erst durch die bijektive Eigenschaft.

Bei der obigen Betrachtung von A, B, S1, S2 und f() existieren drei Sonderfälle. 1) Ein Element aus A kann nicht nach B abgebildet werden, weil f() für dieses Element nicht definiert ist. 2) Für ein bestimmtes Element aus B gibt es kein Element aus A, das auf dieses Element abgebildet wird. 3) Zwei oder mehr Elemente aus A werden auf ein Element in B abgebildet. (Die vierte, logische Kombination, nämlich dass ein Element aus A auf mehrere Elemente aus B abgebildet wird, verbietet der Funktionsbegriff.)

2.1.2 Injektivität, Surjektivität und Bijektivität

Die Begriffe Injektivität, Surjektivität und Bijektitivät entstammen dem mathematischen Sprachgebrauch und müssen daher hier nicht näher erläutert werden. Bedeutsam sind aber die Auswirkungen auf die oben gemachten Aussagen:

![]()

Generell gilt, es existiert eine bijektive Abbildung zwischen zwei Mengen genau dann, wenn ihre Mächtigkeit identisch ist:

![]()

2.1.3 Relationen

Eine

binäre Relation R auf

einer Menge M ist eine Teilmenge von MxM.

Sind ![]() und gilt

und gilt ![]() , so sagt man: „a

und b stehen in der Relation R.“ Gelegentlich schreibt man statt

, so sagt man: „a

und b stehen in der Relation R.“ Gelegentlich schreibt man statt ![]() auch

auch ![]() . Eine Relation kann über eine oder mehrere der folgenden

Eigenschaften verfügen:

. Eine Relation kann über eine oder mehrere der folgenden

Eigenschaften verfügen:

1.

Reflexitivität: ![]()

2.

Transitivität: ![]()

3.

Symmetrie: ![]()

4.

Antisymmetrie: ![]()

Beachte: Symmetrie und Transitivität implizieren nicht Reflexitivität! Zur Bewertung einer Relation muss jede dieser vier Aussagen einzeln überprüft werden.

2.1.4 Äquivalenzrelationen

Man spricht von einer „Äquivalenzrelation“, wenn eine Relation reflexiv, transitiv und symmetrisch ist, und von einer Ordnung, wenn eine Relation reflexiv, transitiv und antisymmetrisch ist. Zum Beispiel ist die normale Vergleichsoperation auf der Menge der reellen Zahlen („=“) eine Äquivalenzrelation, und die kleiner-gleich-Operation („£“) eine Ordnung.

2.1.5 Äquivalenzklassen

Alle Elemente b einer Menge M, die zu einem gegebenen Element a äquivalent sind, bilden zusammen die „Äquivalenzklasse“ des Elementes a:

![]()

Ist die Schnittmenge zweier Äquivalenzklassen nicht leer, so sind die Äquivalenzklassen identisch:

![]()

Bei den Äquivalenzklassen kommt die reflexive Eigenschaft der Relationen zum Tragen, da ohne diese Eigenschaft ein Element nicht in seiner eigenen Äquivalenzklasse enthalten wäre.

Es besteht ein Zusammenhang zwischen den Indizes der Äquivalenzklassen und der Anzahl der Zustände eines Automaten.

2.1.6 Kollektionen

Eine Kollektion ![]() ist eine Menge von Elementen Ci, die über einen Index i indiziert werden können, der aus der

Indiziermenge I stammt.

ist eine Menge von Elementen Ci, die über einen Index i indiziert werden können, der aus der

Indiziermenge I stammt.

2.1.7 Partitionen

Eine Kollektion von Mengen Ci heißt Partition von A genau dann wenn 1) alle Mengen Ci disjunkt oder gleich sind, 2) jede Menge Ci eine Teilmenge von A ist, und 3) die Vereinigung aller Mengen Ci die Menge A ergibt:

Die Menge der Äquivalenzklassen aller Elemente einer gegebenen Menge A ist eine Partition von A: ![]() ist eine Partition

von A.

ist eine Partition

von A.

2.2 Algebraische Strukturen

2.2.1 Die algebraische Struktur

Die algebraische Struktur ist wichtig, da sich jeder endlicher Automat als algebraische Struktur darstellen lässt. Die algebraische Struktur besteht aus einer Menge, und aus einer Rechenoperation auf dieser Menge:

Schreibweise: ![]() oder

oder ![]() .

.

2.2.2 Die Halbgruppe

Die Halbgruppe ist eine algebraische Struktur, für deren Operation das Assoziativgesetz gilt:

2.2.3 Das Monoid

Das Monoid ist eine Halbgruppe mit Einselement:

2.2.4 Das freie Erzeugendensystem, das freie Monoid

G ist ein freies Erzeugendensystem für ![]() , wenn 1) jedes Element aus S als Kombination von Elementen aus G darstellbar ist, und 2) jede dieser Darstellungen eindeutig ist.

, wenn 1) jedes Element aus S als Kombination von Elementen aus G darstellbar ist, und 2) jede dieser Darstellungen eindeutig ist.

Schreibweise: „G ist ein freies Erzeugendensystem für ![]() “ oder „

“ oder „![]() ist ein freies Monoid über G“.

ist ein freies Monoid über G“.

Beispiele:

![]() ist ein freies Monoid

über {1},

ist ein freies Monoid

über {1}, ![]() ist kein freies

Monoid über {1,2}

ist kein freies

Monoid über {1,2}

2.2.5 Der Homomorphismus

Ein Homomorphismus ist die Kombination zweier algebraischer Strukturen ![]() ,

, ![]() und einer Funktion h(), die die Eigenschaft besitzt, kommutativ bezüglich der

Verknüpfungsoperationen (der algebraischen Strukturen) zu sein:

und einer Funktion h(), die die Eigenschaft besitzt, kommutativ bezüglich der

Verknüpfungsoperationen (der algebraischen Strukturen) zu sein:

2.2.6 Der Isomorphismus

Ein Isomorphismus ist ein bijektiver Homomorphismus. Wenn zwei Mengen isomorph zueinander sind, bedeutet das, dass sie sich (von den Bezeichnern ihrer Elemente abgesehen) nicht voneinander unterscheiden lassen. Ein minimaler Automat ist „bis auf Isomorphismen exakt bestimmt“.

Beispiele:

h(n)=2n: h ist Homomorphismus, aber nicht Isomorphismus

2.2.7 Abzählbarkeit

Eine Menge M heißt „abzählbar unendlich“, wenn es eine bijektive Abbildung ihrer Elemente auf die Menge der natürlichen Zahlen gibt:

![]()

![]()

Anmerkung: Wie es der Name sagt, bedeutet „Abzählbarkeit“, dass die Elemente einer Menge zwar zahlreich oder unendlich sind, dass sie aber dennoch abzählbar sind.

Beispiel:

Die Menge der rationalen Zahlen ist abzählbar unendlich, die Menge der irrationalen Zahlen (und damit auch die Menge der reellen Zahlen) ist überabzählbar unendlich.

2.2.8 Konkatenation

Die Konkatenation zweier Mengen S1 und S2 ist die Menge aller „zusammengesetzten“ Elemente dieser beiden Mengen:

![]()

2.3 Sprachen

Sei S eine endliche Menge von Symbolen, und · der Operator für die Konkatenation. Eine Sprache L ist definiert als Teilmenge der Menge aller Wörter über diesem Symbolalphabet:

![]()

![]() ist das freie Monoid

über S,

wobei die Konkatenation („·“) die Operation ist. S dient hier als

freies Erzeugendensystem.

ist das freie Monoid

über S,

wobei die Konkatenation („·“) die Operation ist. S dient hier als

freies Erzeugendensystem.

Die Menge aller Wörter über einem Alphabet S (entspricht S*) ist abzählbar unendlich; die Menge aller Sprachen über S ist überabzählbar unendlich.

2.4 Grammatiken

Die zulässige Form der Sätze einer Sprache nennt man Syntax, die Bedeutung der Sätze wird durch die Semantik beschrieben. Zur Festlegung der Syntax einer Spracheverwendet man Grammatiken. Eine Grammatik ist eine Menge von Regeln, die bestimmen, welche Sätze zur Sprache gehören, und welche nicht. Man spricht von Chomsky-Grammatiken, wenn eine Grammatik durch vier Angaben definiert wird: durch eine Menge von Terminalsymbolen, eine Menge von Nichtterminalsymbolen, eine Menge von Grammatikregeln und durch ein Startsymbol.

Von einer Grammatik wird gefordert, dass sie ein endlich langer Beschreibungsmechanismus für eine Sprache ist. Solche endlich langen Beschreibungsmechanismen können der Länge nach, und innerhalb einer Länge alphabetisch geordnet werden. Somit ist die Menge der Grammatiken abzählbar unendlich. Weil die Menge der Sprachen aber überabzählbar unendlich ist, folgt daraus, dass es Sprachen gibt, die keine Grammatik haben können.

Wie viele Sprachen gibt es, die eine Grammatik haben?

Weil es insgesamt nur abzählbar unendlich viele Grammatiken gibt, ist auch die Menge aller Grammatiken für eine beliebige Sprache über S nur abzählbar unendlich. Daraus folgt, dass die Menge der Sprachen mit Grammatik höchstens ebenfalls abzählbar unendlich ist. „Höchstens“ deswegen, weil u.U. mehrere Grammatiken die selbe Sprache beschreiben.

Wie viele Sprachen gibt es, die keine Grammatik haben?

Es gibt überabzählbar unendlich viele Sprachen, die keine Grammatik haben. Der Beweis gestaltet sich recht einfach. Wir haben bereits festgestellt, dass es nur abzählbar unendlich viele Sprachen gibt, die eine Grammatik haben. Gäbe es ebenfalls nur abzählbar unendlich viele Sprachen, die keine Grammatik haben, so würden auch insgesamt nur abzählbar unendlich viele Sprachen existieren. Wir haben aber bereits festgestellt, dass überabzählbar unendlich viele Sprachen existieren (Widerspruch!).

2.5 Klassifizierung von Sprachen

Noam Chomsky hat 1956 eine Klassifizierung der künstlichen Sprachen vorgeschlagen, die sich bis heute erhalten hat. Sie sieht vor, Grammatiken in insgesamt vier verschiedene Gruppen zu kategorisieren. Jede Gruppe verfeinert die vorhergehende Gruppe, bzw. beinhaltet sie. Zu diesen vier Gruppen hat sich im Laufe der Zeit eine fünfte Gruppe gesellt:

|

Klassifizierung nach Chomsky |

Verschiedene Methoden

(Klassen), |

Grammatiken |

|

Chomsky-3 |

Endliche Automaten |

Reguläre Grammatiken |

|

Chomsky-2 |

Pushdown-Automaten |

Kontext-freie Grammatiken |

|

|

Deterministische Pushdown-Automaten |

LR(z) – Grammatiken |

|

Chomsky-1 |

Linear beschränkte Automaten |

Kontext-sensitive Grammatiken |

|

Chomsky-0 |

Turing-Maschinen |

Rekursiv aufzählbare Mengen |

3 Vorlesung vom 13. April 2000

3.1 Abzählbarkeit von Mengen, Diagonalisierung

3.1.1 Mächtigkeit von Mengen

Mengen sind endliche oder unendliche Ansammlungen von Elementen. Die Anzahl dieser Elemente einer Menge wird Mächtigkeit oder auch Kardinalität genannt. Die formale Notation dafür ist:

![]()

Haben zwei Mengen M1 und M2 die gleiche Mächtigkeit und existiert zwischen den beiden Menge eine bijektive Abbildung, gilt also

![]()

so heißen die Mengen gleichmächtig. Für den Spezialfall, dass eine Menge M gleichmächtig der Menge der natürlichen

Zahlen ![]() ist, so ist die Menge

M abzählbar unendlich. Endliche Mengen sind immer abzählbar.

Dementsprechend wird eine Menge, deren Mächtigkeit größer der Menge der

natürlichen Zahlen ist, für die es also keine bijektive Abbildung zwischen den

beiden Mengen gibt und die somit nicht abzählbar ist, überabzählbar

genannt.

ist, so ist die Menge

M abzählbar unendlich. Endliche Mengen sind immer abzählbar.

Dementsprechend wird eine Menge, deren Mächtigkeit größer der Menge der

natürlichen Zahlen ist, für die es also keine bijektive Abbildung zwischen den

beiden Mengen gibt und die somit nicht abzählbar ist, überabzählbar

genannt.

Einfacher ausgedrückt sind Mengen genau dann abzählbar, wenn ihre Elemente durchnumeriert werden können. Dann existiert eine surjektive Abbildung der natürlichen Zahlen auf die betrachtete Menge, so dass jedes Element der Menge einer natürlichen Zahl zugeordnet ist.

3.1.2 one-to-one-Mapping

Die im vorangegangenen Abschnitt beschriebene Gleichmächtigkeit zweier Mengen kann auch mit dem Schlagwort one-to-one-mapping illustriert werden. Seien beispielsweise folgende Mengen gegeben:

![]()

Dann kann S1 eindeutig auf S2 abgebildet werden mit der Funktion

![]()

Es liegt eine bijektive Abbildung zwischen den beiden Mengen vor, so dass die Mengen von gleicher Mächtigkeit (Kardinalität) sind. Man kann den Begriff one-to-one-mapping verwenden, da jedes Element der einen Menge genau einem Element der anderen Menge zugeordnet wird und umgekehrt.

Ein weiteres Beispiel sei mit folgenden Mengen gegeben:

![]()

![]()

Auch hier liegt eine eindeutige Abbildung von S1 auf S2 vor:

![]()

![]()

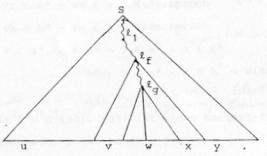

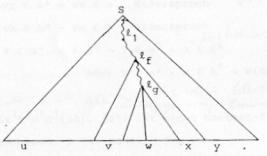

Folglich sind S1 und S2 gleichmächtig, was noch einmal durch eine grafische Diagonalisierung verdeutlicht werden kann.

Abbildung 1 - Grafische Zuordnung von Mengenelementen

Zur Motivation ist anzumerken, dass die detaillierte Beschreibung dieses Themas als sinnvoll zu erachten ist, da viele Beweise der kommenden Wochen in ihrer Basis auf diesem Vorgehen basieren und die Begriffe so zu den Essentials der Veranstaltung gehören.

3.1.3 Abzählbarkeit rationaler Zahlen

Ein Beispiel für einen Beweis der Abzählbarkeit einer

Menge ist die Abzählbarkeit der rationalen Zahlen.

Die rationalen Zahlen ist die Menge der Bruchzahlen, die Vereinigung einer

Zählermenge A und einer Nennermenge B mit A und B gleich Menge der ganzen

Zahlen ![]() .

.

![]()

Dies läßt sich leicht mit einer einfachen Darstellung und der aus der Mathematik bekannten Gesetzmäßigkeit beweisen, dass die Vereinigung abzählbar vieler abzählbarer Mengen (wie die der ganzen Zahlen) wieder eine abzählbare Menge ist.

Jedes Element der Zählermenge besitzt eine abzählbare Menge von Elementen im Nenner, die Menge der ganzen Zahlen eben. Ebenso gibt es eine abzählbare Menge von Zählerelementen, so dass man folgendes unendliches Schema anwenden kann, wobei die Pfeile eine lineare Numerierung bedeuten, beginnend mit der linken oberen Ecke. Folglich ist die Menge der rationalen Zahlen abzählbar unendlich.

Abbildung 2 - Quadratisch unendliches Schema der Bruchzahlen

Formal läßt sich eine Zeile des Schemas folgendermaßen ausdrücken:

![]()

Da alle Pz abzählbar sind, ist auch die Vereinigung abzählbar vieler solcher Mengen abzählbar und damit die Menge der rationalen Zahlen abzählbar:

![]()

3.1.4 Überabzählbarkeit reeller Zahlen

Die Menge der reellen Zahlen ist die Menge der Dezimalzahlen mit endlichen und unendlicher Periode. Man kann die Zahlen im Bereich ]0,1[ in einem Schema anordnen und dann eine Cantorsches Diagonalverfahren genannte Methode anwenden. Ist bereits dieses Intervall nicht abzählbar, so ist die gesamte Menge der reellen Zahlen überabzählbar.

Nehmen wir zunächst an, das Intervall sei abzählbar und es

existiere dementsprechend eine surjektive Abbildung ![]() . Sei xn eine Zahl aus diesem Intervall, die sich

aus Stellen a1,a2,a3,... zusammensetzt:

. Sei xn eine Zahl aus diesem Intervall, die sich

aus Stellen a1,a2,a3,... zusammensetzt:

Sei nun c eine weitere Zahl aus dem Intervall mit

![]()

wobei sich ci folgendermaßen zusammensetzt, also Stellen aus xn neu zusammensetzt (diagonal im Schema wegen aii):

![]()

Somit ist gewährleistet, dass ci niemals gleich aii ist und mindestens in einer Stelle verschieden. Damit ist c ungleich jedem beliebigen xn. Wenn das Intervall abzählbar ist, müßte ein xj mit xj = c existieren. Das ist jedoch ein Widerspruch und somit ist das Intervall der nicht abzählbar. Daraus folgt, dass die reellen Zahlen ebenfalls nicht abzählbar, sondern überabzählbar sind.

Würde man diesen Beweis auf die Menge der rationalen Zahlen anwenden, könnte man leicht den Fehler machen und übersehen, dass es sich bei xn um Dezimalzahlen mit unendlicher Periode handelt. So ist bei den rationalen Zahlen das c ebenfalls ungleich jedem beliebigen xn. Allerdings ist c zugleich auch nicht mehr Element der rationalen Zahlen (sondern der reellen). Die Bedingung der Abgeschlossenheit ist damit nicht mehr erfüllt und somit nichts über die Abzählbarkeit der Menge der rationalen Zahlen ausgesagt.

3.2 Transitive und reflexive Hülle

3.2.1 Definition

Das Relationenprodukt zweier Relationen R und S wird folgendermaßen definiert:

![]()

Dabei wird gewissermaßen die Transitivität über zwei Relationen hinweg ausgedrückt. Insbesondere heißt eine Relation transitiv, wenn das Relationenprodukt mit sich selbst wieder Teilmenge der Relation ist:

![]()

![]()

Bestimmt man dieses Relationenprodukt unendlich oft und vereinigt anschließend die Relationenprodukte, so erhält man den transitiven Abschluß (auch transitive Hülle genannt):

![]()

Für R0 definiert man die identische, reflexive Abbildung auf der Menge A:

![]()

Die Vereinigung von transitiver Hülle und der identischen Abbildung R0 wird reflexive Hülle genannt:

![]()

Ein interessanter Anwendungsfall der transitiven Hülle in Verbindung mit einer Relationenmatrix ist das Wege-Problem, bei dem die kürzeste Entfernung zwischen zwei Punkten über andere Punkte hinweg gesucht (traveling salesman problem)

3.2.2 Beispiele

Sei R eine Relation mit

![]()

auf der Menge A mit

![]()

Dann ergibt sich die transitive Hülle R+ von R folgendermaßen

![]()

und die relfexive Hülle R* entsprechend

![]()

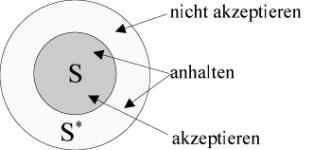

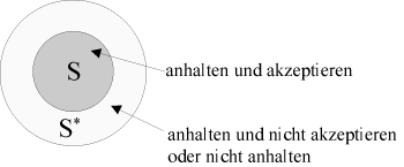

3.3 Endliche Automaten (FSM, DFA)

3.3.1 Veranschaulichung und Darstellung

Ein Automat kann als eine Blackbox, beispielsweise als Modell eines elektrischen Schaltwerks betrachtet werden. Füttert man den Automaten mit einer Eingabe, kann er diese akzeptieren oder nicht akzeptieren. Damit lassen sich Eingaben in die Gruppe der erkannten und die Gruppe der nicht erkannten Wörter einordnen, wobei die Menge der erkannten Wörter die Sprache ist, auf die der Automat hält.

Mit Hilfe eines Automaten läßt sich also eine Sprache definieren, genau wie bei der Definition einer Grammatik, nur dass bei der Grammatik die Wörter der Sprache gewissermaßen als Produkt entstehen, während der Automat die Eingabewörter auf ihre Zugehörigkeit zu der betrachteten Sprache prüft.

Wie beschrieben, erkennt ein Automat eine Sprache ![]() . Das läuft so ab, dass der Automat ein beliebigen Wort x1x2...xn

als Eingabe erhält und Zeichen für Zeichen gemäß Übergangsfunktion abarbeitet.

Er wechselt dabei so lange den Zustand, bis das letzte Eingabezeichen erreicht

ist. Befindet sich der Automat dann in einem Endzustand, dann gehört das

Eingabewort zur Sprache L. Befindet er sich in einem anderen Zustand, gehört

das Wort nicht zur Sprache L.

. Das läuft so ab, dass der Automat ein beliebigen Wort x1x2...xn

als Eingabe erhält und Zeichen für Zeichen gemäß Übergangsfunktion abarbeitet.

Er wechselt dabei so lange den Zustand, bis das letzte Eingabezeichen erreicht

ist. Befindet sich der Automat dann in einem Endzustand, dann gehört das

Eingabewort zur Sprache L. Befindet er sich in einem anderen Zustand, gehört

das Wort nicht zur Sprache L.

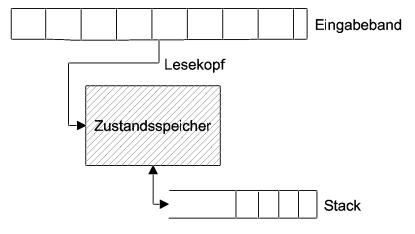

Verdeutlicht wird das Prinzip durch eine bildhafte Darstellung wie folgt. Dabei ließt der Automat über einen Lesekopf die Eingabe vom Eingabeband und wechselt entsprechend der Übergangsfunktion zwischen den Zuständen. Tritt der Automat in einen Endzustand, so wird dies hier durch ein Signal vermerkt.

Abbildung 3 - Prinzip eines endlichen Automaten

Die übliche anschauliche Notation eines endlichen Automaten ist der Graph. Eine Kante verbindet Knoten, die den Zuständen entsprechen. Für jedes Zeichen des Eingabealphabets gibt es eine eigene Kante, die vom jeweiligen Zustand zu einem Folgezustand führt.

3.3.2 Definition

Ein deterministischer endlicher Automat auch Finite State Maschine (FSM) oder Deterministic Finite Automation (DFA) genannt, setzt sich aus fünf charakteristischen Eigenschaften zusammen, so dass ein solcher Automat ein 5-Tupel darstellt:

![]()

Dabei bezeichnet Q die Menge der Zustände, S das Eingabealphabet, d die Übergangsfunktion, q0 den Startzustand und F die Menge der Endzustände. Ausführlicher haben die 5 Elemente folgende Funktionen:

· Q ist eine endliche Menge von Zuständen (daher der Name!)

· S ist eine endliche Menge von Eingabesymbolen, das Eingabealphabet

·

![]() ist eine Übergangsfunktion (kartesisches Produkt von Zustand

und Eingabesymbol), die einem Zustand und Element des Eingabealphabets einen

Folgezustand zuordnet

ist eine Übergangsfunktion (kartesisches Produkt von Zustand

und Eingabesymbol), die einem Zustand und Element des Eingabealphabets einen

Folgezustand zuordnet

·

q0 ist der Startzustand des Automaten mit ![]()

·

F ist eine Menge von Endzuständen (akzeptierende Zustände) mit ![]()

Charakteristisch für diesen Automatentyp (es gibt auch weitere wie wir später sehen werden) ist, dass jeder Kombination aus Zustand und Eingabesymbol ein eindeutiger Folgezustand zugeordnet wird. Verschiedene Kombinationen können jedoch auf den gleichen Folgezustand zeigen.

3.3.3

Erweiterung von  auf

auf

Um Wörter auf ihre Sprachzugehörigkeit zu prüfen, ist es sinnvoll, als Eingabe für eine Übergangsfunktion nicht nur einzelne Zeichen sondern ganze Wörter zuzulassen. Diese neue Übergangsfunktion wird dann d* genannt. Da sie auf dem freien Monoid S arbeitet, kann sie auch das leere Wort verarbeiten. Prinzipiell handelt es sich bei d* um eine rekursive Mehrfachausführung des einfachen d.

Es gelten folgende Axiome:

![]()

![]()

![]()

Zur Vereinfachung der Notation legt man fest, dass

![]()

Daraus folgt, dass die

akzeptierte Sprache des Automaten ![]() definiert ist als

definiert ist als

![]()

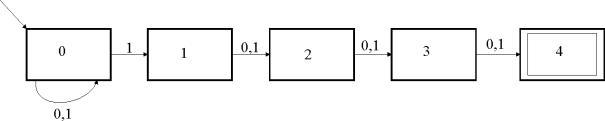

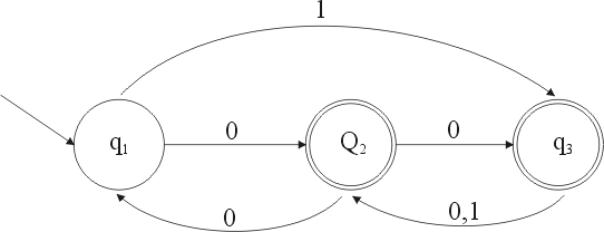

3.3.4 Beispiel eines endlichen Automaten

Ein Beispiel eines endlichen, deterministischen Automaten sei ein Automat, der eine Sprache erkennt, die aus einer beliebig langen Folge von ab besteht:

![]()

Mit Hilfe eines Induktionsbeweises, der ausführlich am nächsten Vorlesungstag behandelt wird, kann die Korrektheit des folgenden Graphen bewiesen werden:

Abbildung 4 - Beispiel eines endlichen Automaten

4 Vorlesung vom 18. April 2000

4.1 Beweis eines DFA (deterministischer endlicher Automat)

Bereits im letzten Protokoll wurde unser Beispielautomat vorgestellt. Er erkennt die folgende Sprache:

Der Automat selbst ist in der folgenden Abbildung graphisch dargestellt:

Abbildung 5 - Beispiel eines endlichen Automaten

4.2 Vorgehensweise

Was haben wir nun zu tun, wenn wir beweisen wollen, dass

der gezeigte endliche Automat wirklich die Sprache T(M) akzeptiert? Wir müssen

zeigen, dass der Automat wirklich nur für die Zeichenfolgen im Endzustand ![]() landet, die in der Sprachspezifikation angegeben wurden.

landet, die in der Sprachspezifikation angegeben wurden.

Die allgemeine Vorgehensweise lautet für einen solchen Beweis dann wie folgt:

1. Aufstellen

von Induktionsbehauptungen für jeden Zustand des endlichen Automaten, also für

jedes ![]() . Die Induktionsbehauptungen haben die allgemeine Form

. Die Induktionsbehauptungen haben die allgemeine Form

2. Beweis der Behauptungen per Induktion

3. Beweis

der gewünschten Spracheigenschaft durch folgende Äquivalenz. Mit „gewünschter

Sprachspezifikation“ ist eine Beschreibung von ![]() in der Form gemeint, dass

in der Form gemeint, dass ![]() die gewünschte Sprache darstellen.

die gewünschte Sprache darstellen.

![]()

Bei oberflächlicher Betrachtungsweise fragt man sich leicht, wieso es nicht reicht, die Induktionsbehauptungen für die Endzustände zu beweisen. Dies liegt daran, dass die Endzustände i. d. R. nur über andere Zustände erreicht werden können, deren Eigenschaften also auch bewiesen werden müssen.

4.2.1 Beweis des Beispiels

Zu zeigen:

Wir haben zu zeigen: ![]()

Wir stellen nun zunächst die Induktionsbehauptungen gemäß auf. Hierzu betrachten wir im Transitionsdiagramm (Abbildung 5) jeden einzelnen Zustand und überlegen uns, wann (für welche Eingabefolgen) dieser Zustand erreicht werden kann. Diese Überlegungen führen uns zu den folgenden Behauptungen:

4.2.2 Induktionsbehauptungen:

Als Erläuterung der

Induktionsbehauptungen betrachten wir : Nach dem Transitionsdiagramm

kann ![]() nur dann erreicht

werden, wenn – ausgehend vom Startzustand

nur dann erreicht

werden, wenn – ausgehend vom Startzustand ![]() - eine „ab“-Folge mit

abschließendem „a“ als Eingabezeichenkette vorliegt (z. B. „ababababa“). Die

Anzahl der Zeichen ist hierbei stets ungerade.

- eine „ab“-Folge mit

abschließendem „a“ als Eingabezeichenkette vorliegt (z. B. „ababababa“). Die

Anzahl der Zeichen ist hierbei stets ungerade.

4.2.3 Induktionsverankerung:

Wir beweisen durch Induktion über die Länge der Eingabefolgen und wählen n=1 (also eine Zeichenkette der Länge 1). Wir zeigen für die einzelnen Induktionsbehauptungen deren Richtigkeit für n=1:

zu ![]()

zu ![]()

zu ![]()

zu ![]()

Hierzu folgende Erläuterungen: Die Äquivalenzen sind

natürlich dadurch zu zeigen, dass man die Implikationen sowohl von links nach

rechts (![]() ) als auch von rechts nach links (

) als auch von rechts nach links (![]() ) begründen muss.

) begründen muss.

Zum Falle von ist zu sagen, dass zunächst

(„![]() “) der Fall, mit n=1 (nur einem Zeichen)

“) der Fall, mit n=1 (nur einem Zeichen) ![]() nicht zu erreichen

ist. Damit ist die Prämisse falsch, die Implikation also wahr. Die andere

Richtung („

nicht zu erreichen

ist. Damit ist die Prämisse falsch, die Implikation also wahr. Die andere

Richtung („![]() “): n ist ungerade, damit ist wiederum die Prämisse falsch

und die Implikation wahr.

“): n ist ungerade, damit ist wiederum die Prämisse falsch

und die Implikation wahr.

Zu : Nach dem Transitionsdiagramm

wird ![]() bereits mit einem

Eingabezeichen verlassen und kann nie wieder erreicht werden.

bereits mit einem

Eingabezeichen verlassen und kann nie wieder erreicht werden.

4.2.4

Induktionsschritt ( ):

):

Wir nehmen hier eine Fallunterscheidung vor. Solche Fallunterscheidungen sind in Induktionsbeweisen von endlichen Automaten häufig vorzunehmen. In unserem Falle bietet sich eine Fallunterscheidung nach dem Kriterium „n gerade?“ an, da dieses Kriterium in unseren Induktionsbehauptungen eine Rolle spielt.

Fall 1: n+1 gerade, n ungerade

Zu :

Wie ist das nun zu lesen? Um nach ![]() zu kommen, muss man

nach dem Transitionsdiagramm im vorletzten Schritt in

zu kommen, muss man

nach dem Transitionsdiagramm im vorletzten Schritt in ![]() gewesen sein.

gewesen sein.

Weil nun ![]() gilt, kann kann Fall

gilt, kann kann Fall ![]() schon mal nicht

vorkommen.

schon mal nicht

vorkommen. ![]() kann nicht vorkommen,

weil n ungerade ist. Damit gilt die Prämisse von nicht und die Implikation von

links nach rechts ist wahr. Liest man von rechts nach links, dann

gelten

kann nicht vorkommen,

weil n ungerade ist. Damit gilt die Prämisse von nicht und die Implikation von

links nach rechts ist wahr. Liest man von rechts nach links, dann

gelten ![]() ebenfalls nicht und damit ist die Äquivalenz insgesamt gezeigt.

ebenfalls nicht und damit ist die Äquivalenz insgesamt gezeigt.

Zu :

Wieder haben wir das Transitionsdiagramm betrachtet und

sind diesmal nur auf ![]() als letzten möglichen Schritt gestoßen.

als letzten möglichen Schritt gestoßen.

Wir betrachten nun zunächst den Weg von links nach rechts in :

Natürlich muss auch der Rückweg gezeigt werden. Dies funktioniert aber analog:

Damit haben wir die Äquivalenz gezeigt.

Zu :

Hier ergibt sich:

Wie zuvor scheidet ![]() aus, da

aus, da ![]() und

und ![]() scheidet aus, weil n ungerade

ist.

scheidet aus, weil n ungerade

ist.

„![]() “ Wir wählen zunächst den Schritt von links nach rechts:

“ Wir wählen zunächst den Schritt von links nach rechts:

I.1 (q1)

I.2 (q3)

„![]() “ Jetzt beweisen wir den Rückweg und beachten zuvor die

folgende Regel:

“ Jetzt beweisen wir den Rückweg und beachten zuvor die

folgende Regel:

![]()

II. 1 (not sonst)

II.2 (sonst)

zu :

![]() ist ein Widerspruch,

da

ist ein Widerspruch,

da ![]() . Damit kann dieser Fall nicht vorkommen.

. Damit kann dieser Fall nicht vorkommen.

Fall 2: n+1 ungerade, n gerade

Dieser Fall ist ganz analog wie Fall 1 zu behandeln:

Zu :

![]() scheidet nach der

Induktionsannahme aus, weil

scheidet nach der

Induktionsannahme aus, weil ![]() gilt.

gilt.

Zu :

Es gilt:

Auch dieser Fall scheidet aus, weil n ungerade ist.

Zu :

Dieser Fall ist ähnlich wie beim Fall n ungerade zuvor

zu :

Ist genauso wie oben.

4.2.5 Beweis der Sprachäquivalenz

Wir müssen nun noch mit Hilfe der aus dem Induktionsbeweis gewonnenen Erkenntnis, wann die Endzustände erreicht werden, zeigen, dass der endliche Automat aus Abbildung 5 tatsächlich T(M) realisiert:

4.3 Nichtdeterministische Endliche Automaten (NFA)

Neben den deterministischen endlichen Automaten (DFA) existieren auch nichtdeterministische endliche Automaten (NFA), die sich dadurch auszeichnen, dass bei einem Zustand bei demselben Eingabesymbol keine, eine oder mehr Transitionen erlaubt sind.

Die nichtdeterministischen Automaten sind insbesondere ein nützliches Konzept zum Beweis von Sätzen. Weiter wird sich zeigen, dass die NFAs äquivalent zu den DFAs sind. Insbesondere kann man auch DFAs als einen Spezialfall der NFAs auffassen, nämlich als einen, bei dem es je Zustand eine einzige Transitions für jedes Symbol gibt.

Um zu bestimmen, ob eine bestimmte Zeichenkette w von einem DEA akzeptiert wird, genügt es, diesen einen Pfad zu prüfen. Bei einem NFA kann es viele Pfade geben, die mit w markiert sind. Hier müssen also alle Pfade überprüft werden.

4.3.1 Formale Definition

Definition (NFA):

Ein nichtdeterministischer endlicher Automat ist ein Quintupel

![]() mit:

mit:

1. Q ist eine endliche Menge von Zuständen

2. S ist eine endliche Menge von Eingabesymbolen

3.

![]() ist der

Anfangszustand

ist der

Anfangszustand

4.

![]() ist die Menge der Endzustände (= akzeptierten Zustände)

ist die Menge der Endzustände (= akzeptierten Zustände)

5.

![]() (Potenzmenge) ist die

Übergangsfunktion

(Potenzmenge) ist die

Übergangsfunktion

Wichtig hierbei ist, dass die Ergebnismenge der

Übergangsfunktion ![]() nun also die Potenzmenge von Q ist. d

liefert jetzt also immer eine Menge von Zuständen. Dabei bedeutet

nun also die Potenzmenge von Q ist. d

liefert jetzt also immer eine Menge von Zuständen. Dabei bedeutet ![]() die Menge aller Zustände p, für die es einen mit a markierten

Übergang von q nach p gibt.

die Menge aller Zustände p, für die es einen mit a markierten

Übergang von q nach p gibt. ![]() bedeutet, dass der

Übergang für (q,a) undefiniert ist.

bedeutet, dass der

Übergang für (q,a) undefiniert ist.

4.3.2 Erweiterung von d des NFA

Die Funktion d kann folgendermassen auf eine Funktion d* ausgedehnt werden.

Definition (d*):

(Erweiterung von ![]() auf

auf ![]() ):

):

1. ![]()

2.

![]()

3.

![]()

4.3.3 Die vom NFA erkannte Sprache

Definition (vom NFA erkannte Sprache):

Sei ![]() ein

nichtdeterministischer endlicher Automat (NFA). Dann heißt

ein

nichtdeterministischer endlicher Automat (NFA). Dann heißt ![]() die von M erkannte

Sprache.

die von M erkannte

Sprache.

Anmerkung: Diese Definition impliziert, dass es wenigstens einen Weg von Startzustand aus geben muss, mit dem man über das Wort x in einem Endzustand landet.

4.3.4 Beispiel eines NFA

Wir betrachten den NFA, der die Sprache ![]() akzeptiert:

akzeptiert:

Abbildung 6 – Beispiel eines NFA

Aus diesem Transitionsdiagramm kann man nun die folgenden Transitionen erkennen:

Um diese zu erhalten, geht man wie folgt vor (wir

betrachten das Beispiel ![]() ):

):

Betrachte die beiden Zustände ![]() . Wohin gelangt man jeweils bei einer weiteren Eingabe von

„a“? Von q2 aus gelangt man nach q1 (also bilde die Menge {q1}), von q4 aus gelangt man mit „a“

nirgendwohin (bilde die leere Menge {}). Dann vereinige die gefundenen

Ergebnismengen. Es ergibt sich die Menge {q1}. Also gilt:

. Wohin gelangt man jeweils bei einer weiteren Eingabe von

„a“? Von q2 aus gelangt man nach q1 (also bilde die Menge {q1}), von q4 aus gelangt man mit „a“

nirgendwohin (bilde die leere Menge {}). Dann vereinige die gefundenen

Ergebnismengen. Es ergibt sich die Menge {q1}. Also gilt: ![]() .

.

Wir beweisen nun bei diesem NFA, dass er die Sprache ![]() abbildet. Wir

verwenden hierbei Induktion.

abbildet. Wir

verwenden hierbei Induktion.

Induktionsverankerung (n <= 2):

Induktionsschritt:

Man beweise durch Induktion

![]() :

:

Diese Behauptung müsste nun per Induktion formal bewiesen werden.

Gesamtbeweis

Zusammenfassend mit dem gelungenen Induktionsbeweis folgt also:

5 Vorlesung vom 20. April 2000

5.1 Über die Äquivalenz von DFA und NFA[1]

Da jeder DFA ein NFA ist, ist es klar[2], dass die Klasse der Sprachen, welche ein NFA akzeptiert die Sprachen enthält, die von einem DFA akzeptiert werden. Es stellt sich jedoch heraus, dass auch nur diese Sprachen von NFA akzeptiert werden. Der Beweis dafür baut darauf auf, dass gezeigt werden kann, dass ein DFA einen NFA simulieren kann. (Für jeden NFA kann ein equivalenter DFA konstruiert werden.) Der DFA simuliert einen NFA indem die einzelnen Zustände des DFA den Mengen von Zuständen des NFA entsprechen. Der so konstruierte DFA überwacht all die Zustände, die der NFA durch die selbe Eingabefolge erreichen (wie der DFA) könnte. Somit gelangt man zu dem folgendem Theorem:

5.1.1 Theorem

Wenn ![]() eine akzeptierte Sprache für einen nichdeterministischen

endlichen Automaten ist, dann existiert ein deterministischer endlicher

Automat, der auch

eine akzeptierte Sprache für einen nichdeterministischen

endlichen Automaten ist, dann existiert ein deterministischer endlicher

Automat, der auch ![]() akzeptiert. In anderen Worten: Sei

akzeptiert. In anderen Worten: Sei ![]() eine Sprache, dann sind folgende Aussagen gleichwertig:

eine Sprache, dann sind folgende Aussagen gleichwertig:

1. ![]() für einen

deterministischen endlichen Automaten

für einen

deterministischen endlichen Automaten ![]()

2.

![]() für einen

nichtdeterministischen endlichen Automaten

für einen

nichtdeterministischen endlichen Automaten ![]()

5.1.2 Beweis des Buches

Sei ![]() ein NFA, welcher die Sprache

ein NFA, welcher die Sprache ![]() akzeptiert. Ein DFA

akzeptiert. Ein DFA ![]() sei dann wie folgt

definiert: Die Zustände von

sei dann wie folgt

definiert: Die Zustände von ![]() sind alle Teilmengen

der Menge der Zustände von M. Das heißt:

sind alle Teilmengen

der Menge der Zustände von M. Das heißt: ![]() .

. ![]() wird alle Zustände behandeln, welche auch

wird alle Zustände behandeln, welche auch ![]() behandeln kann.

behandeln kann. ![]() ist die Menge, der Zustände von

ist die Menge, der Zustände von ![]() , welche einen Endzustand von

, welche einen Endzustand von ![]() enthalten. Ein Element von

enthalten. Ein Element von ![]() wird dargestellt, als

wird dargestellt, als ![]() , wobei

, wobei ![]() aus

aus ![]() stammen. Zu beachten ist, dass

stammen. Zu beachten ist, dass ![]() ein einziger Zustand

des DFA darstellt. Weiterhin ist

ein einziger Zustand

des DFA darstellt. Weiterhin ist ![]() .

.

Wir definieren nun:

![]()

dann und nur dann, wenn:

![]()

In anderen Worten, ![]() angewendet auf

angewendet auf ![]() von

von ![]() wird berechnet, durch anwenden von

wird berechnet, durch anwenden von ![]() auf jeden Zustand von

auf jeden Zustand von ![]() , welcher durch

, welcher durch ![]() repräsentiert wird. Durch das Anwenden von

repräsentiert wird. Durch das Anwenden von ![]() auf alle

auf alle ![]() und vereinigen der Ergebnisse, erhalten wir eine neue Menge von Zuständen,

und vereinigen der Ergebnisse, erhalten wir eine neue Menge von Zuständen, ![]() . Diese neue Menge hat einen Vertreter

. Diese neue Menge hat einen Vertreter ![]() in

in ![]() und dieser ist der

Wert von

und dieser ist der

Wert von ![]() .

.

Es lässt sich nun durch

Induktion über die Länge eines Eingabestrings ![]() zeigen, dass

zeigen, dass

![]()

dann und nur dann gilt, wenn:

![]()

Induktionsverankerung:

Man sieht leicht, dass für ![]() die Behauptung gilt, da

die Behauptung gilt, da ![]() und

und ![]() gleich

gleich ![]() sein muss.

sein muss.

Induktionsschritt:

Angenommen, die Behauptung

ist wahr für Eingaben der Länge ![]() . Weiterhin sei

. Weiterhin sei ![]() eine Kette der Länge

eine Kette der Länge ![]() mit

mit ![]() in

in ![]() . Dann gilt:

. Dann gilt:

![]()

Aufgrund der Behauptung ist:

![]()

dann und nur dann wahr, wenn:

![]()

gilt. Doch mit der

Definition von ![]() gilt:

gilt:

![]()

dann und nur dann, wenn:

![]()

gilt. Somit ist:

![]()

dann und nur dann, wenn:

![]()

und das unterstützt die Behauptung. Um den Beweis zu

vollenden, muss nur noch hinzugefügt werden, dass ![]() genau dann zu

genau dann zu ![]() führt, wenn

führt, wenn ![]() einen Zustand von

einen Zustand von ![]() enthält, der in

enthält, der in ![]() liegt. Somit ist

liegt. Somit ist ![]()

Soweit der Beweis des Buches, in der Vorlesung haben wir den Beweis nur geringfügig anders gehört.

5.1.3 Beweis der Vorlesung

Zur Wiederholung hier noch einmal den zu beweisenden Satz:

Sei ![]() eine Sprache, dann sind folgende Aussagen gleichwertig:

eine Sprache, dann sind folgende Aussagen gleichwertig:

1. ![]() für einen

deterministischen endlichen Automaten

für einen

deterministischen endlichen Automaten ![]()

2.

![]() für einen

nichtdeterministischen endlichen Automaten

für einen

nichtdeterministischen endlichen Automaten ![]()

„Hinrichtung“:

Zuerst zeigen wir hier, mit einfachen Definitionen, aus 1

folgt 2. Gegeben sei ein DFA ![]() mit

mit ![]() . Dieser Automat akzeptiert die Sprache

. Dieser Automat akzeptiert die Sprache ![]() nach Definition. Nun definieren wir uns dazu einen NFA

nach Definition. Nun definieren wir uns dazu einen NFA ![]() mit einer

Übergangsfunktion

mit einer

Übergangsfunktion ![]() .

.

Diese Übergangsfunktion ist wie folgt definiert:

![]()

Aus dieser Definition folgt nun schon, dass ![]() ein

nichtdeterministischer Automat ist. Der einzige Unterschied zum DFA besteht

darin, dass die Übergangsfunktion so definiert ist, dass sie eine Menge von Folgezuständen liefert. In unserem Fall sind dies jedoch alles

einelementige Mengen.

ein

nichtdeterministischer Automat ist. Der einzige Unterschied zum DFA besteht

darin, dass die Übergangsfunktion so definiert ist, dass sie eine Menge von Folgezuständen liefert. In unserem Fall sind dies jedoch alles

einelementige Mengen.

Durch Induktion über alle ![]() kann man dies zeigen:

kann man dies zeigen:

In diesem Beweis ist ausgenutzt worden, dass ein Wort nur

dann von einem NFA erkannt wird, wenn die Menge von ![]() eine Teilmenge von

eine Teilmenge von ![]() ist. Dies bedeutet

für einen gleichwertigen DFA, dass dieses

ist. Dies bedeutet

für einen gleichwertigen DFA, dass dieses ![]() sein muss, um

akzeptiert zu werden. Dies war bei uns nach Definition der Fall.

sein muss, um

akzeptiert zu werden. Dies war bei uns nach Definition der Fall.

Rückrichtung:

Nun bleibt noch zu zeigen, dass der umgekehrte Fall gilt.

Sprich, wir haben einen NFA gegeben und wollen daraus einen DFA konstruieren.

(Aus 2 folgt 1): Hier sei ein NFA ![]() mit einer

Übergangsfunktion

mit einer

Übergangsfunktion ![]() gegeben. Auch dieser Automat soll nach Definition die Sprache

gegeben. Auch dieser Automat soll nach Definition die Sprache

![]() akzeptieren.

akzeptieren.

Wir definieren nun einen

DFA ![]() wie folgt:

wie folgt:

Der so definierte Automat ist ein deterministischer endlicher Automat. Nun bleibt zu zeigen, dass jeder Zustand, den der DFA erreicht, der Menge von Zuständen entspricht, die der NFA erreicht hätte:

![]()

Dies wird wieder durch Induktion über die Länge der Eingaben bewiesen.

Induktionsbehauptung:

![]()

Induktionsverankerung (n=0):

![]() Man sieht leicht, dass für leere Eingaben der Definition der

Man sieht leicht, dass für leere Eingaben der Definition der ![]() -Funktion nach das selbe Ergebnis (das Bleiben im Startzustand

-Funktion nach das selbe Ergebnis (das Bleiben im Startzustand ![]() ) erreicht wird.

) erreicht wird.

Induktionsschritt (![]() ):

):

Bei diesem Beweis haben wir folgendes Wissen angewendet.

Da es ein DFA ist, nimmt man den Zustand, der mit den ersten ![]() Symbolen (Von diesen

wissen wir aufgrund der Behauptung, dass für diese die Übergangsfunktion

Symbolen (Von diesen

wissen wir aufgrund der Behauptung, dass für diese die Übergangsfunktion ![]() gleichwertig mit

gleichwertig mit ![]() ist.) erreicht hat und vereinigt diesen mit dem Zustand, der

durch das

ist.) erreicht hat und vereinigt diesen mit dem Zustand, der

durch das ![]() Symbol erreicht wird. Und die Vereinigung der Teilmengen der ersten

Symbol erreicht wird. Und die Vereinigung der Teilmengen der ersten ![]() Symbole zusammen mit

dem Symbol

Symbole zusammen mit

dem Symbol![]() ist gleichbedeutend mit der Übergangsfunktion

ist gleichbedeutend mit der Übergangsfunktion ![]() angewendet auf die Symbole

angewendet auf die Symbole ![]() . Nun ist noch zu zeigen, dass auch die selben Wörter

akzeptiert werden.

. Nun ist noch zu zeigen, dass auch die selben Wörter

akzeptiert werden.

Auch dieser Beweis ist wieder mittels der Definitionen von

![]() geführt worden.

geführt worden.

Somit steht fest, dass es für alle nichtdeterministischen

endlichen Automaten ![]() ein deterministischer

endlicher Automat

ein deterministischer

endlicher Automat ![]() existiert für den die

folgenden zwei Aussagen gelten:

existiert für den die

folgenden zwei Aussagen gelten:

1. ![]()

2.

![]()

Die erste Aussage haben wir eben bewiesen. Die zweite Aussage folgt aus der Betrachtung der möglichen Potenzmenge. Hier der kurze Induktionsbeweis.

Induktionsbehauptung:

Für alle ![]() mit

mit ![]() gilt

gilt ![]() .

.

Induktionsverankerung:

Für ![]() gilt

gilt ![]() .

.

Induktionsschritt (![]() ):

):

Bei der Betrachtung der Symbole ![]() steht folgendes fest. Die Anzahl der Teilmengen ohne

steht folgendes fest. Die Anzahl der Teilmengen ohne ![]() beträgt

beträgt ![]() . Die Anzahl der Teilmengen mit

. Die Anzahl der Teilmengen mit ![]() beträgt

beträgt ![]() . Zusammen gibt dies:

. Zusammen gibt dies: ![]() . Damit ist die Behauptung gezeigt.

. Damit ist die Behauptung gezeigt.

5.1.4 Beispiel 1 (Konstruktion eines DFA aus einem NFA)

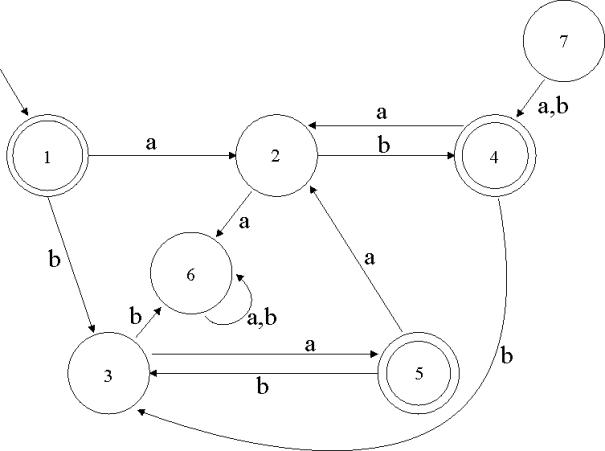

Abbildung 7 – ein nichtdeterministischer, endlicher Automat M

Dieser Automat akzeptiert offensichtlich die Sprache ![]() .

.

Ein deterministischer endlicher Automat könnte so aussehen:

Abbildung 8 - Der DFA, der zu' M äquivalent ist

In diesem Beispiel hat der DFA ![]() 9 Zustände, während

der NFA

9 Zustände, während

der NFA ![]() 6 Zustände hatte. Und

das liegt noch einiges unter den maximal

6 Zustände hatte. Und

das liegt noch einiges unter den maximal ![]() möglichen Zuständen.

möglichen Zuständen.

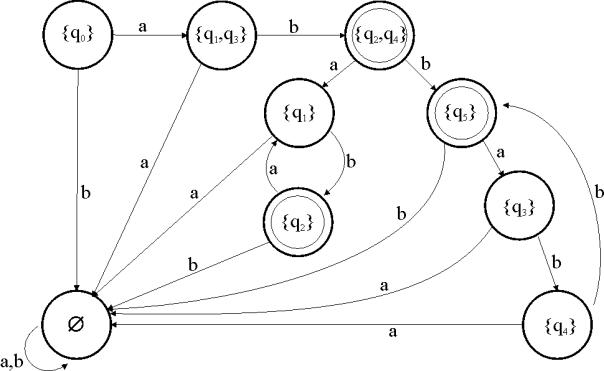

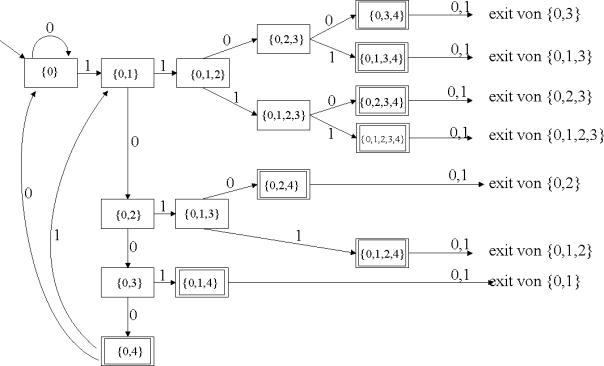

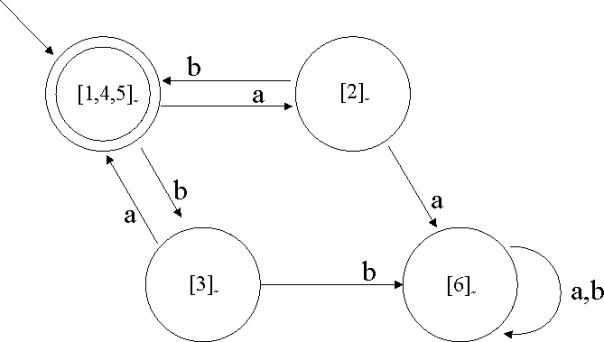

5.1.5 Beispiel 2 (Konstruktion eines DFA aus einem NFA)

Hier nun ein etwas komplexeres Beispiel. Es soll ein NFA

umgewandelt werden, der die Sprache ![]() akzeptiert. Ein

solcher NFA kann so aussehen:

akzeptiert. Ein

solcher NFA kann so aussehen:

Abbildung 9: NFA zur Sprache L4

Einen DFA für die Sprache bildet dann:

Abbildung 10: der aus dem NFA erzeugte DFA für die Sprache L4

Bei diesem Beispiel benötigt der NFA 5 Zustände, der DFA jedoch 16 Zustände. Es stellt sich nun die Frage, ob diese Konstruktion auch wirklich minimal ist.

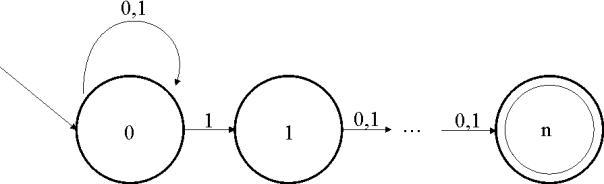

5.2 Satz über die Minimierung von Zuständen

Für alle ![]() gilt: Die Sprache

gilt: Die Sprache ![]() kann von einem

nichtdeterministischen Automaten mit

kann von einem

nichtdeterministischen Automaten mit ![]() Zuständen akzeptiert

werden. Dann folgt für jeden deterministischen Automaten

Zuständen akzeptiert

werden. Dann folgt für jeden deterministischen Automaten ![]() mit der Sprache

mit der Sprache ![]()

![]() .

.

Beweis:

Sei ![]() gegeben. Weiterhin

auch ein NFA

gegeben. Weiterhin

auch ein NFA ![]() der diese Sprache akzeptiert, also

der diese Sprache akzeptiert, also ![]() . Ein Graph dieses Automaten kann wie folgt aussehen:

. Ein Graph dieses Automaten kann wie folgt aussehen:

Abbildung 11: NFA für die Sprache Ln

Sei nun weiterhin ![]() ein DFA, der die selbe Sprache akzeptiert, also

ein DFA, der die selbe Sprache akzeptiert, also ![]() .

.

Behauptung: Jedes Wort des möglichen

Eingabealphabetes (von ![]() möglichen Wörtern) muss von dem Automaten unterschieden

werden können.

möglichen Wörtern) muss von dem Automaten unterschieden

werden können.

![]()

Angenommen zwei gleichlange Wörter aus ![]() , die unterschiedlich sind (d.h. sie unterscheiden sich nach

einigen gleichen Zeichen an einer Stelle, danach folgt ein Wort z) hätten

dieselben Nachfolgezustände.

, die unterschiedlich sind (d.h. sie unterscheiden sich nach

einigen gleichen Zeichen an einer Stelle, danach folgt ein Wort z) hätten

dieselben Nachfolgezustände.

Dann werden entweder beide Wörter akzeptiert, oder aber keines. In beiden Fällen macht der Automat einen Fehler.

Der Widerspruch liegt darin, dass ![]() Element der Sprache

Element der Sprache ![]() ist,

ist, ![]() jedoch nicht,

trotzdem wird für beide Wörter die selbe Entscheidung getroffen, folglich

benötigt man für unterschiedliche Eingabewörter unterschiedliche Zustände. Die

maximale Anzahl der Zustände beträgt, wie schon vorher gezeigt

jedoch nicht,

trotzdem wird für beide Wörter die selbe Entscheidung getroffen, folglich

benötigt man für unterschiedliche Eingabewörter unterschiedliche Zustände. Die

maximale Anzahl der Zustände beträgt, wie schon vorher gezeigt ![]() .

.

6 Vorlesung vom 25. April 2000

6.1 Nachtrag zur vorherigen Vorlesung

Gegeben ist die folgende (reguläre) Sprache:

![]()

Korollar:

Es gibt für jede dieser Sprachen einen nichtdeterministischen, endlichen Automaten, welcher mit n+1 Zuständen auskommt:

![]()

Es gibt für jede dieser Sprachen einen deterministischen, endlichen Automaten, welcher mit weniger als 2n+1 Zuständen auskommt:

![]()

Jeder deterministische, endliche Automaten, der eine dieser Sprachen beschreibt, besitzt mindestens 2n Zustände.

![]()

Satz:

Es gibt für jede dieser Sprachen einen nichtdeterministischen, endlichen Automaten, welcher mit n Zuständen auskommt:

![]()

Jeder deterministische, endliche Automaten, der eine dieser Sprachen beschreibt, besitzt mindestens 2n Zustände.

![]()

Beweis:

Der Beweis gestaltet sich umfangreich, deswegen wird an dieser Stelle darauf verzichtet.

6.2 Mathematischer Hintergrund

6.2.1 Erweiterung des Begriffes „Äquivalenzrelation“

Man spricht von einer „Äquivalenzrelation“, wenn eine Relation reflexiv, transitiv und symmetrisch ist, und von einer Ordnung, wenn eine Relation reflexiv, transitiv und antisymmetrisch ist. Zum Beispiel ist die normale Vergleichsoperation auf der Menge der reellen Zahlen („=“) eine Äquivalenzrelation, und die kleiner-gleich-Operation („£“) eine Ordnung.

Unter dem „Index“ einer Äquivalenzrelation versteht man die Maximalzahl paarweise verschiedener Äquivalenzklassen.

6.2.2 Rechts-Invarianz

Eine Äquivalenzrelation ![]() auf einer algebraischen Struktur

auf einer algebraischen Struktur ![]() mit einer binären Verknüpfung

mit einer binären Verknüpfung ![]() heißt „rechts-invariant“

heißt „rechts-invariant“

![]()

6.2.3 Links-Invarianz

Eine Äquivalenzrelation ![]() auf einer algebraischen Struktur

auf einer algebraischen Struktur ![]() mit einer binären Verknüpfung

mit einer binären Verknüpfung ![]() heißt „links-invariant“

heißt „links-invariant“

![]()

6.2.4 Kongruenzrelation

Eine Äquivalenzrelation ![]() auf einer algebraischen Struktur

auf einer algebraischen Struktur ![]() mit einer binären Verknüpfung

mit einer binären Verknüpfung ![]() heißt „Kongruenzrelation“:

heißt „Kongruenzrelation“:

Eine Kongruenzrelation ist eine mit der Struktur verträgliche Äquivalenzrelation. Zum Beispiel ist auf dem Körper der reellen Zahlen die Gleichheitsoperation („=“) bezüglich der Operationen „Addition“ („+“) und „Multiplikation“ („ד) eine Kongruenzrelation:

![]()

6.2.5 Quotientenmenge

Eine „Quotientenmenge“ wird auf Basis einer Menge, und einer Kongruenzrelation definiert. Man versteht dann unter der „Quotientenmenge“ die Menge aller Äquivalenzklassen, welche (bezüglich der gegebenen Kongruenzrelation) innerhalb der gegebenen Menge existieren.

Gegeben sei die algebraische Struktur ![]() und die Kongruenzrelation „~“. Unter der

„Quotientenmenge“ von

und die Kongruenzrelation „~“. Unter der

„Quotientenmenge“ von ![]() und ~ versteht man:

und ~ versteht man:

![]()

6.2.6 Quotientenmonoid

Unter dem „Quotientenmonoid“ versteht man die

Zusammenfassung der Quotientenmenge mit einer Operation auf dieser Menge. Die Abbildung ![]() (der Elemente der ursprünglichen Menge auf die der

Quotientenmenge) definiert man sinnvollerweise als einen Homomorphismus[3].

Die neue Operation für das Quotientenmonoid sei „

(der Elemente der ursprünglichen Menge auf die der

Quotientenmenge) definiert man sinnvollerweise als einen Homomorphismus[3].

Die neue Operation für das Quotientenmonoid sei „![]() “.

“.

Das „Quotientenmonoid“ ergibt sich dann als:

![]()

Die Rechenregeln für das Quotientenmonoid leiten sich direkt aus der homomorphen Eigenschaft der Abbildung her:

Man sieht an der obigen Herleitung, wie bedeutsam die Eigenschaften „Kongruenz“ und „Transitivität“ der Kongruenzrelation „~“ für die Quotientenmenge sind.

Beispiel 1:

Gegeben sei die Menge der natürlichen Zahlen ![]() mit der Verknüpfung „ד (Multiplikation), und

ein Modul m. Zwei Zahlen gelten als äquivalent bezüglich „~“, wenn sie den

gleichen Rest bei einer Division durch m

abwerfen:

mit der Verknüpfung „ד (Multiplikation), und

ein Modul m. Zwei Zahlen gelten als äquivalent bezüglich „~“, wenn sie den

gleichen Rest bei einer Division durch m

abwerfen:

![]()

Gemäß dieser Definition ist z.B. bei m=5 die Zahl 11 äquivalent zu 31: 11~31. Es handelt sich bei „~“ um eine Äquivalenzrelation, da die Bedingungen Reflexitivität, Transitivität und Symmetrie erfüllt sind (der Nachweis dieser Eigenschaften sollte keine Probleme bereiten).

Es handelt sich bei „~“ aber nicht nur um eine Äquivalenzrelation, sondern sogar um eine Kongruenzrelation. Der Nachweis hierfür ist etwas aufwendiger:

Nach gilt:

Die abschließende Implikation sollte nach kurzem Nachdenken für jedermann ersichtlicherweise korrekt sein; ein Beweis an dieser Stelle ist nicht nötig.

Daher gelten gemäß und die folgenden Rechengesetze:

6.3 Reguläre Ausdrücke

6.3.1 Kleenesche Hülle

Sei S eine endliche Menge von Symbolen und seien L,

L1 und L2 Mengen von Zeichenketten

aus S*.

Die Konkatenation von L1

und L2 – geschrieben

als L1L2 –

ist die Menge ![]() . Die Zeichenketten in L1L2 werden gebildet, indem man an eine

aus L1 gewählte

Zeichenkette eine Zeichenkette aus L2

anhängt und das in allen möglichen Kombinationen. Wir definieren nun:

. Die Zeichenketten in L1L2 werden gebildet, indem man an eine

aus L1 gewählte

Zeichenkette eine Zeichenkette aus L2

anhängt und das in allen möglichen Kombinationen. Wir definieren nun:

L* bezeichnet also alle Wörter, die durch die Konkatenation einer beliebigen Anzahl von Wörtern aus L entstehen.

Beispiel:

Sei ![]() und

und ![]() . Dann ist

. Dann ist ![]() . Ebenso gilt

. Ebenso gilt ![]() .

.

6.3.2 Reguläre Ausdrücke

Die von endlichen Automaten akzeptierten Sprachen lassen sich durch einfache Ausdrücke beschreiben, die als „reguläre Ausdrücke“ bezeichnet werden. Auf Grund dieser Äquivalenz werden die Sprachen der endlichen Automaten auch „reguläre Mengen“ genannt.

Oder umgekehrt: Reguläre Ausdrücke bilden einen Formalismus zur Beschreibung formaler Sprachen.

Zwei reguläre Ausdrücke heißen „äquivalent“, wenn sie die gleiche formale Sprache beschreiben (z.B. [ab]*a und a[ba]*). Die Äquivalenz regulärer Ausdrücke lässt sich über algebraische Gesetze zeigen.

6.3.3 Reguläre Ausdrücke vs. endliche Automaten

Satz:

Die folgenden drei Aussagen sind äquivalent:

3.

L ist reguläre

Sprache/reguläre Menge

![]()

4.

L ist die

Vereinigung von einigen Äquivalenzklassen einer rechts-invarianten

Äquivalenzrelation von endlichem Index.

![]()

5. Sei RL eine Relation, die wie folgt definiert ist:

![]()

Dann ist RL von endlichem Index.

Beweis:

1 Þ 2:

Wenn L eine reguläre Menge ist, dann existiert ein endlicher Automat (DFA/NFA), der exakt diese Menge beschreibt:

![]()

Sei r eine Äquivalenzrelation, welche alle Wörter aus S*, die zu dem selben Zustand des Automaten führen, in einer Äquivalenzklasse zusammenfasst:

Die Äquivalenzrelation r ist rechts-invariant:

![]()

Dann lässt sich hieraus die Behauptung folgern:

Wieso lässt sich diese Behauptung folgern? Nun, gehen wir

von dem Gegenteil aus, nämlich dass ![]() . Das würde bedeuten, dass es mehr Wörter gibt, als es

Zustände gibt, die aber dennoch alle zu verschiedenen Zuständen führen. Der

Widerspruch dieser Annahme liegt auf der Hand.

. Das würde bedeuten, dass es mehr Wörter gibt, als es

Zustände gibt, die aber dennoch alle zu verschiedenen Zuständen führen. Der

Widerspruch dieser Annahme liegt auf der Hand.

Damit lässt sich die reguläre Menge L darstellen als Menge der Eingabewörter, welche zu einem der akzeptierenden Zustände des Automaten führt. Jeder akzeptierende Zustand des Automaten kann bezüglich der Äquivalenzrelation (definitionsgemäß) nur von einer Klasse von Eingabewörtern erreicht werden.

Die reguläre Menge L können wir darstellen als Vereinigung aller akzeptierenden Zustände des Automaten, und damit als Vereinigung einiger Äquivalenzklassen einer rechts-invarianten Äquivalenzrelation von endlichem Index:

![]()

2 Þ 3:

Im vorangegangenen Teil wurde die Äquivalenzrelation r eingeführt, diese benutzen wir weiterhin. Darüber hinaus definieren eine (zweite) Äquivalenzrelation RL wie folgt:

Die Definition der Äquivalenzrelation RL ist etwas kompliziert. Textuell formuliert bedeutet , dass alle jenen Wörter aus S* in Relation stehen, die a) entweder beide in der Sprache enthalten sind, oder beide nicht in der Sprache enthalten sind; und b) die Bedingung a) auch dann noch erfüllen, wenn ihnen ein beliebiges Wort „angehängt wird“.

Die Definition dieser Äquivalenzrelation erinnert an die Zustandsminimierung via Implikationstafel. Man bezeichnet dabei alle Zustände als „äquivalent“, die bei den selben Eingabesymbolen in die selben Nachfolgezustände, oder in äquivalente Nachfolgezustände überführt werden.

Behauptung:

Beweis zu :

Bei dem Beweis machen wir uns die Tatsache zunutze, dass die Äquivalenzrelation r rechts-invariant ist:

Aus der Tatsache, dass jedes Paar von Eingabewörtern aus S*, dass in der Äquivalenzrelation r enthalten ist, automatisch auch in der Äquivalenzrelation RL enthalten ist, resultiert, dass die Äquivalenzklasse eines beliebigen Eingabewortes bezüglich der Äquivalenzrelation r eine Teilmenge der Äquivalenzklasse bezüglich der Äquivalenzrelation RL ist:

Daraus folgt, dass es bezüglich der Äquivalenzrelation r mindestens so viele (disjunkte) Äquivalenzklassen geben muss, wie bezüglich der Äquivalenzrelation RL:

Daraus wiederum folgt, dass auch der Index der Äquivalenzrelation RL endlich sein muß:

![]()

2 Þ 3:

Behauptung:

Die Äquivalenzrelation RL ist rechts-invariant.

Beweis:

6.4 Nerode Automat

6.4.1 Definition des Nerode Automaten

Mit dem bisher erlangten Wissen, ist es möglich, einen minimalen Automaten zu erstellen, der eine reguläre Sprache repräsentiert. Dieser Automat heißt „Nerode Automat“.

Zur Konstruktion des Nerode Automaten wird erneut die Äquivalenzrelation RL herangezogen, die wie folgt definiert ist:

Die Menge der unterschiedlichen Äquivalenzklassen, die durch RL definiert werden, wird im Folgenden mit „QN“ bezeichnet:

Der Nerode Automat ist definiert als:

![]()

mit

![]()

![]()

dN ist damit wohldefiniert.

6.4.2 Repräsentantenunabhängigkeit des Nerode Automaten:

Im Folgenden wird gezeigt, dass die Übergangsfunktion dN wohldefiniert ist, d.h. ihre Definition repräsentantenunabhängig ist. Dazu ist es nötig, zu zeigen, dass die Übergangsfunktion für alle Eingabewörter, die äquivalent sind, den selben Nachfolgezustand liefert.

Zu zeigen:

![]()

Beweis:

6.4.3 Regularität des Nerode Automaten:

Im Folgenden wird bewiesen, dass die Sprache, die der Nerode Automat erzeugt/definiert, eine reguläre Sprache ist.

6.4.4 Minimalität des Nerode Automaten

Im Folgenden wird bewiesen, dass der Nerode Automat minimal ist, d.h. dass jeder endliche Automat, der die selbe Sprache L definiert, mindestens genauso viele Zustände haben muß wie MN.

Satz:

Der Nerode Automat ist minimal.

Beweis:

Der Beweis ist ein Widerspruchsbeweis. Es wird angenommen, dass sehr wohl ein Automat existiert, der die selbe Sprache L definiert, der aber mit weniger Zuständen auskommt:

Die Definition der Äquivalenzrelation r wird aus , und übernommen:

![]()

Weil die Menge QN der Menge der Äquivalenzklassen entspricht, die durch die Äquivalenzrelation RL definiert werden (siehe ), gilt:

Aus , , und folgt:

6.4.5 Eindeutigkeit des Nerode Automaten

Satz:

Sei ![]() ein minimaler Automat für eine Sprache L mit

ein minimaler Automat für eine Sprache L mit ![]() . Sei

. Sei ![]() der Nerode Automat für L mit

der Nerode Automat für L mit ![]() . Dann ist M

isomorph zu MN. D.h.

es existiert ein Isomorphismus

. Dann ist M

isomorph zu MN. D.h.

es existiert ein Isomorphismus

![]()

Beweis:

Weil sowohl M als auch MN minimal sind, müssen sie über die gleiche Anzahl an Zuständen verfügen:

![]()

Sei h() so definiert, dass es jeden Zustand q aus der Menge der Zustände Q auf eine Äquivalenzklasse bezüglich der Äquivalenzrelation RL abbilde (wir erinnern uns: die Äquivalenzklassen bezüglich der Äquivalenzrelation RL liegen dem konstruierten Nerode Automaten zugrunde).:

![]()

7 Vorlesung vom 27. April 2000

7.1 Nerode Automat

7.1.1 Homomorphismus und Isomorphismus

Gegeben seien zwei Gruppen S1

und S2 mit ![]() und

und ![]() . Eine Abbildung

. Eine Abbildung ![]() heißt Homomorphismus,

wenn für alle

heißt Homomorphismus,

wenn für alle ![]() gilt

gilt

Eine Illustration verdeutlicht das

Ist eine homomorphe Abbildung bijektiv, so wird sie isomorph genannt. Man sagt, die Struktur beider Gruppen ist gleich, sie unterscheiden sich nur in den Bezeichnungen der Elemente.

7.1.2 Minimalität und Eindeutigkeit des Nerode Automaten

Nachdem in den vorangegangenen Abschnitten gezeigt wurde, dass der Nerode Automat minimal ist, vergleichen wir ihn jetzt mit anderen minimalen Automaten. Dabei werden wir feststellen, dass alle minimalen Automaten (DFA) einer Sprache L die gleiche "Verdrahtung" ihrer Zustände haben und sich lediglich in der Bezeichnung der Zustände unterscheiden, sie also isomorph sind.

Sei L eine Sprache, die von einem minimalen Automaten M und dem Nerode Automaten MN erkannt wird

![]()

dann seien M und MN wie oben beschrieben isomorph, d. h. es existiert ein Homomorphismus

![]()

Das wird in folgendem Schaubild illustriert

Abbildung 13 - Homomorphismus zwischen Automat M und Nerode Automat

Es existiert eine Abbildung h, die alle Zustände von M in Zustände in MN (Äquivalenzklassen) überführt. Formal ausgedrückt

![]()

Hier stellt sich die Frage, ob h eindeutig definiert ist. Alle Wörter x und y, die den Automaten M in den gleichen Zustand überführen, müssen auch MN in die gleiche Äquivalenzklasse überführen. Zu Zeigen ist, dass x und y der gleichen Äquivalenzklasse von RL angehören.

Beweis:

Zum Beweis führen wir eine neue Äquivalenzrelation ~ ein

![]()

Überführen zwei Wörter x und y den Automaten in den gleichen Zustand, so sind sie äquivalent. Da die Anzahl der Zustände der oben betrachteten Automaten minimal und gleich ist, gilt für den Index (die Anzahl der maximal paarweise verschiedenen Äquivalenzklassen) der ~ Relation

![]()

Weiterhin gelte

![]()

Somit ist h als eindeutige Abbildung von Zuständen Q auf Äquivalenzklassen aus QN definiert.

Könnte es Zustände q in Automat M geben, für die h(q) nicht definiert ist?

![]()

Wenn ein solcher Zustand existieren würde, dann gebe es kein Wort x, dass den Automaten in diesen Zustand überführt und der Zustand somit überflüssig. Damit wäre M nicht mehr minimal und ein Widerspruch läge vor. h ist für alle Zustände q aus Q definiert.

Surjektivität von h

![]()

Injektivität von h

Wenn ![]() zwei verschiedene

Zustände aus Q sind und [x] und [y] ihre Abbildungen in QN, dann

gilt

zwei verschiedene

Zustände aus Q sind und [x] und [y] ihre Abbildungen in QN, dann

gilt

Dann sind x und y nicht äquivalent zueinander (bezüglich

der ~ Relation) und damit gilt Injektivität von h (![]() gilt immer).

gilt immer).

Isomorphismus von h

Da h injektiv und surjektiv, ist die Abbildung bijektiv. h ist daher ein Isomorphismus. Für einen Zustand q existiert ein x, dass den Automaten M in diesen Zustand überführt.

![]()

Die Herleitung zeigt, dass es egal ist, ob die Konkatenation von x und a zunächst in der Urmenge (die Zustände von Q) stattfindet und dann nach QN abgebildet wird oder umgekehrt.

Damit ist h isomorph und als Korollar kann festgestellt werden, dass alle minimalen Automaten (DFA) isomorph sind. Anders ausgedrückt sind alle minimalen Automaten bis auf Isomorphien eindeutig bestimmt. Die Verdrahtung der Zustände ist gleich, lediglich die Zustandsbezeichnung kann variieren.

7.2 Minimierung von endlichen Automaten

7.2.1 Rekursion der k Relationen

Endliche Automaten können sich in einem nicht minimalen Zustanden befinden. Mit einiger Logik und Transformation lassen sie sich in minimale Automaten überführen, die isomorph zum Nerode Automaten sind (wenn es sich denn um DFAs handelt - bei NFAs ist die Anzahl der nicht isomorphen minimalen Automaten u. U. beliebig groß).

Für die Minimierung - auch Zustandsreduktion genannt - führen wir zunächst eine neue Äquivalenzrelation k zwischen zwei Zuständen q und q' ein. Zustände sind bezüglich k äquivalent, wenn sie Wörter x, deren Länge kleiner gleich k ist, in einen Endzustand überführen oder beide Zustände die Wörter nicht in einen Endzustand überführen.

Der Betrachtung zugrunde liegt ein endlicher Automat ![]() mit q und q' Zuständen aus Q. Dann seien folgende

Äquivalenzrelationen definiert

mit q und q' Zuständen aus Q. Dann seien folgende

Äquivalenzrelationen definiert

Scheinbar besteht zwischen der auf eine Wortlänge k beschränkten und der allgemeinen ~ Relation ein Zusammenhang. Daher behaupten wir

Behauptung:

![]()

Beweis:

Die genau-dann-wenn Beziehung der obigen Behauptung beweisen wir in beide Richtungen. Wenn die k Relation gilt, dann muß auch die k-1 Relation gelten, da die k Relation alle Wörter enthält, die auch in k-1 enthalten sind.

Seien ein Wort ![]() und ein Zeichen

und ein Zeichen ![]() beliebig gewählt, dann gilt

beliebig gewählt, dann gilt

![]()

und die Zustände q und q' gehören zur k-1 Relation

![]()

Damit ist gezeigt

![]()

Gilt bereits die k-1 Relation, so zeigen wir, dass

die Behauptung in der anderen Richtung gilt. Für ![]() gilt

gilt

![]()

Sei ![]() und

und ![]() . Dann läßt sich zeigen

. Dann läßt sich zeigen

Somit gilt die Behauptung auch in der anderen Richtung

![]()

7.2.2 Verfeinerung von Äquivalenzrelationen

Zwischen Äquivalenzrelationen lassen sich Beziehungen ausdrücken, d. h. sie können kongruent oder verschieden sein. Nehmen wir die beiden Äquivalenzrelationen r1 und r2 die auf der Menge S liegen. Sind die r1 und r2 kongruent, dann

![]()

Andernfalls ist eine Relation kleiner oder echt kleiner als die andere. Man spricht von Verfeinerung

![]()

7.2.3 Anwendung auf k Relation zur Zustandsreduktion

Betrachtet man die k Relationen, dann enthält die k Relation höchstens gleich viele Zustände wie die k‑1 Relation. k ist daher eine Verfeinerung von k-1

![]()

Wir behaupten zudem

![]()

Beweis:

Die Behauptung kann man durch Induktion beweisen. Für s = 0 ist die Aussage klar, da es sich um dieselbe Relation k handelt. Für alle weiteren nehmen wir an, dass

![]()

bereits gelte. Dann kann man auf k+s+1 gehen

Korollar:

Der Index der k‑1 Relation ist kleiner als der der k Relation

![]()

Damit haben wir als Ausgangspunkt für weitere Betrachtungen folgende Aussagen zusammengestellt

![]()

![]()

![]()

8 Vorlesung vom 2. Mai 2000

8.1 Minimierung mittels Nerode Automaten

8.1.1 Satz über die Gleichwertigkeit von Relationen

Sei ![]() ein endlicher

deterministischer Automat mit der Mächtigkeit

ein endlicher

deterministischer Automat mit der Mächtigkeit ![]() . Dann gilt:

. Dann gilt: ![]() .

.

Der Beweis der „Hinrichtung“. ist trivial und folgt auch schon aus dem Satz der letzten Vorlesung. Die „Rückrichtung“ ist da schon komplizierter. Der Beweis erfolgt indirekt. Angenommen die beiden Relationen währen nicht identisch:

![]()

Grundsätzlich gilt, dass ~ eine Verfeinerung von ![]() ist. Damit muss

ist. Damit muss ![]() eine echte Verfeinerung von

eine echte Verfeinerung von ![]() sein, denn sonst wäre ja

sein, denn sonst wäre ja ![]() , was ein Widerspruch zur Annahme wäre.

, was ein Widerspruch zur Annahme wäre.

Durch eine Betrachtung der Anzahl der Klassen der Zustände

(![]() ) erkennt man schnell, dass es mindestens eine Klasse von

Zuständen geben muss, und zwar die der akzeptierenden Zustände. Da weiterhin

gilt, dass

) erkennt man schnell, dass es mindestens eine Klasse von

Zuständen geben muss, und zwar die der akzeptierenden Zustände. Da weiterhin

gilt, dass ![]() eine echte Verfeinerung von

eine echte Verfeinerung von ![]() ist, sind alle

anderen Relationen echte Verfeinerungen (also gilt

ist, sind alle

anderen Relationen echte Verfeinerungen (also gilt ![]() ). Die Anzahl der Klassen wächst durch jeden Index um eins.

Führt man diesen Gedankengang fort und beachtet, dass es alles echte

Verfeinerungen sind, so gelangt man für den

). Die Anzahl der Klassen wächst durch jeden Index um eins.

Führt man diesen Gedankengang fort und beachtet, dass es alles echte

Verfeinerungen sind, so gelangt man für den ![]() zu dem Schluss, dass

dieser mindestens

zu dem Schluss, dass

dieser mindestens ![]() Klassen enthalten

muss.

Klassen enthalten

muss.

Dies ist allerdings ein Widerspruch, da es höchstens ![]() (mit

(mit ![]() ) Äquivalenzklassen auftreten können.

) Äquivalenzklassen auftreten können.

8.1.2 Konstruktion eines minimalen Automaten

Sei nun ~ weiterhin wie

bisher definiert. Dann gibt es zu dem endlichen Automaten ![]() einen äquivalenten

minimalen Automaten

einen äquivalenten

minimalen Automaten ![]() . Dabei ist:

. Dabei ist:

Dieser Automat wird wie folgt konstruiert, als Zustände nehme man die Äquivalenzklassen der Zustände. Als akzeptierte Zustände gelten die Äquivalenzklassen der Tilderelation von F.

Damit ist ![]() ein minimaler Automat

mit

ein minimaler Automat

mit ![]() .

.

Aber ist dieser Automat auch wirklich minimal, oder nur ein reduzierter Automat? Gezeigt wird dies durch den folgenden Beweis:

![]() ist mit :

ist mit :

![]()

wohldefiniert, aus folgendem Grund: Wenn ![]() und

und ![]() in der selben

Äquivalenzklasse liegen und die Relation definiert sind, dann ist auch

in der selben

Äquivalenzklasse liegen und die Relation definiert sind, dann ist auch ![]() mit

mit ![]() in Relation.

in Relation.

Mit der Definition von ![]() gilt dann:

gilt dann:

Somit akzeptieren also beide Automaten die selbe Sprache. Die Frage ist nun, ob dieser Automat auch minimal ist.

Zuerst definieren wir die ![]() Relation als:

Relation als:

![]()

Weiterhin wissen wir über

diesen Automaten, dass der ![]() , da jeder Zustand erreichbar ist. Somit wissen wir, dass die

, da jeder Zustand erreichbar ist. Somit wissen wir, dass die

![]() Relation die Nerode-Automat Relation

Relation die Nerode-Automat Relation ![]() verfeinert:

verfeinert:

![]()

Gilt nun auch, die

Umkehrung? Folgt aus ![]() ? Der Beweis erfolgt durch Kontraposition.

? Der Beweis erfolgt durch Kontraposition.

![]()

Die Klassen können nicht gleich sein, da es die Elemente nicht in der ~ Relation gibt. Es gibt daher ein Element z, so dass:

Die beiden Relationen sind also gleichwertig: ![]() . Und die Minimalzahl der Zustände ist:

. Und die Minimalzahl der Zustände ist: ![]() Und damit ist

gezeigt, dass der Automat

Und damit ist

gezeigt, dass der Automat ![]() minimal ist.

minimal ist.

8.2 „Praktische“ Minimierung von deterministischen endlichen Automaten

Nachdem wir wissen, dass die Bestimmung der

Äquivalenzklassen ![]() definiert ist für:

definiert ist für:![]() . Eine Konstruktion, die den (bis auf Isomorphie) eindeutig

bestimmten minimalen endlichen Automaten (